- 首页

- ·

- 热门文献

-

演讲实录

-

CAAI会士专栏

-

GAITC 2021 演讲速记

-

GAITC 2020 演讲速记

-

GAITC 2019 演讲速记

-

GAITC 2018 演讲速记

-

GAITC 2017 演讲速记

-

GAITC 2016 演讲速记

-

CCAI 2022 演讲速记

-

CCAI 2021 演讲速记

-

CCAI 2020 演讲速记

-

CCAI 2019 演讲速记

-

CCAI 2018 演讲速记

-

CCAI 2017 演讲速记

-

CCAI 2016 演讲速记

-

CIIS 2020 演讲速记

-

CIIS 2019 演讲速记

-

CIIS 2018 演讲速记

-

CIIS 2017 演讲速记

-

CIIS 2016 演讲速记

-

CCIS 2019 演讲速记

-

CAAI人工智能大讲堂 2018

-

吴奖 2018 演讲速记

-

WRC 2017 演讲速记

-

CIEC 2016 演讲速记

-

2016“探寻大师足迹”系列第二站

-

2016“探寻大师足迹”系列第一站

-

CAAI AIDL 第八期(2019)

-

CAAI AIDL 第七期(2019)

-

CAAI AIDL 第二期(2017)

-

CAAI AIDL 第一期(2017)

CCAI 2021 演讲实录丨田奇院士:共筑智能新高地 共赢智能新未来——华为云盘古大模型

发布时间:2021-11-10

10月12-13日,2021中国人工智能大会(CCAI 2021)在成都成功举办。在10月12日举办的大会主论坛上,国际欧亚科学院院士、华为云人工智能领域首席科学家、IEEE Fellow田奇院士为我们带来了题为《共筑智能新高地 共赢智能新未来——华为云盘古大模型》的精彩演讲。

田奇

国际欧亚科学院院士

华为云人工智能领域首席科学家

IEEE Fellow

以下是田奇院士的演讲实录:

2021年3月,我国发布了“十四五”规划和2035年远景目标纲要,聚焦十大数字化应用场景,从智慧交通、智慧医疗到智慧农业、智慧政务等;重点发展七大数字经济重点产业,如云计算、大数据、人工智能等;在人工智能方面全要素的布局主要有几点,如攻关AI根技术、发展AI产业、建设AI基础设施、构建公共数据集等。

下面主要介绍华为云在攻关AI根技术,以及发展AI学术和人才生态方面的工作。

一、盘古大模型

众所周知,人工智能已经进入了千行百业,开始创造更大价值。在华为云600多个人工智能的实践项目中,有30%进入了企业核心系统,帮助客户平均盈利18%。人工智能进入各领域面临很多挑战,最大的挑战之一是AI应用场景碎片化的问题,也就是过去的这种定制化的、作坊式的开发难以规模化复制;第二,难以把行业知识与AI技术相结合;第三,行业对于普通的AI模型在攻击、隐私、安全方面的一些担忧。

我们的工作主要是针对第一个场景碎片化的问题。一个场景、一个模型指的是过去这种定制化的、作坊式的开发,遇到任务后从零开始,艰难迭代,如果达不到要求就要推倒重来,局限于特定的场景和数据。这样的开发方式导致高成本、高门槛,没有经验和数据的积累。

在人类社会工业化的过程中,机器起到了至关重要的作用(如蒸汽机、智能生产线),工业化使生产效率大大提高。今年4月,华为云发布的盘古大模型是对过去定制化的、作坊式的开发迈向AI工业开发的一个尝试。盘古大模型,首先它是大模型,设计了超大的神经网络来吸取海量的知识,找出数据之间的共性。其模型的训练包括三个阶段,第一个阶段叫做预训练阶段,也是算力消耗最大的阶段;第二个阶段是基于行业数据的微调,以及端侧、边侧、云侧的部署;第三个阶段就是新数据会不断产生,如何根据新数据让大模型进行迭代,实现终身学习。同时我们开发流水线的工具集成,让模型的训练更快,效率提升10倍以上。

盘古大模型包括NLP大模型、CV大模型、多模态大模型和科学计算大模型四大类。我们在设计大模型时有三个核心的设计原则,一个是希望这个网络规模要大,所以NLP是首个千亿级参数量的中文大模型;第二,模型大,但不能大而臃肿,希望有强壮的网络架构,也就是希望它是百米冠军,系统的性能要做到极致,综合性能提升10%以上;第三,希望它有优秀的泛化能力,也就是场景覆盖率要高,不仅是单项的百米冠军,也希望是10项全能冠军。

盘古大模型有很多应用,比如工业缺陷检测、图像审核、内容审核、工业质检、知识图谱、证券,以及银行方面的一些风控等,平均的开发效率提升了90%,在性能上有5%~10%的提升。大模型的打造过程中出现了非常多的创新研究,比如视觉的一些分类、检测和分割,很多单点技术获得了业界挑战赛的冠军。另外,模型压缩与量化、多模态和小样本学习、视觉预训练模型等都沉淀到了盘古大模型。

(一)NLP大模型

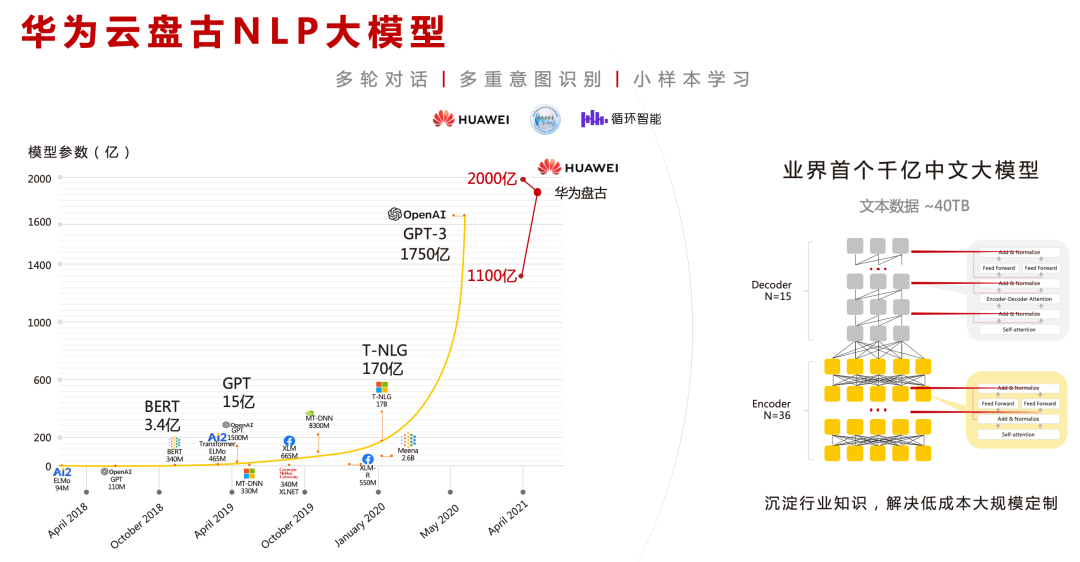

这几年, 自然语言处理,尤其在预训练模型取得了突破性进展。2018 年 10 月发布的 BERT 达到了3.4亿的模型参数;2020年1月,微软的图灵T-NLG模型达到了 170 亿参数;2020 年 5 月,OpenAI GPT-3 达到了 1 750 亿的参数;今年华为发布了 1 100 亿和 2 000 亿的盘古大模型;10 月 12 日微软和英伟达也发布了威震天 - 图灵大模型,达到了 5 300亿参数。所以,大模型近年引起了业界极大关注,也获得了蓬勃发展,在今年 4 月我们发布的盘古大模型就是业界首个千亿中文大模型。

在实际的华为盘古NLP模型中,应用了通用知识和行业经验,实际销售场景中,金融的销售转化率提升了2倍以上,客户满意度提升了15%;因为具有兼顾生成与理解的能力,所以它的生成与理解性能当时也达到了领先;在CLUE榜单上内容理解和分类方面,榜单上都达到了第一;同时生成任务也达到了世界第一,小样本学习能力超越了之前的GPT系列。

NLP盘古中文大模型在医疗场景也做了命名实体的提取。医疗业务场景的挑战,由于医学术语和通用语言之间的差别比较大,而且医疗知识比较复杂,知识抽取困难,我们在医疗语料和通用语料上做了多领域融合的多任务预训练。在实际场景中诊断效率提升了10%~20%。

盘古NLP中文大模型在智慧文旅的应用,主要是借助阅读理解系统和旅游知识图谱,实现对用户询问的多轮实时回答。基于大模型预训练的意图理解和知识提取的能力,可扩展并适用于多种现实的应用场景。

在客服销售系统方面,主要是银行、保险线上线下的网点销售场景,借助销售的实时辅助系统,通过话术挖掘,提升初级销售产能50%以上、中级销售产能10%~30%。

(二)CV大模型

盘古 CV 大模型也是业界最大的 CV 预训练模型,发布时有 30 亿参数,也是首个判别与生成联合预训练的模型,在 100 多个场景得到了验证,并且其小样本学习性能在 10% 的标签分类上精度达到了业界第一,研发成本降低了 90% 以上。盘古 CV 大模型分为预训练、微调和部署、迭代三个阶段。

盘古CV大模型在国网电力巡检中的应用。对比过去传统用20多个模型做电力缺陷识别,现在只用一个盘古CV大模型。并且盘古CV大模型让缺陷样本的筛选效率提升了30倍以上,筛选质量提升了5倍以上,识别精度平均提升了18%,一个模型的通用性达到了过去20个效果,开发效率提升了10倍以上。

高铁作为必不可少的出行方式,其运营线路已经达到2万余公里,在如此庞大铁路网的背后,需要极大的人力成本维修或维护。但是当前设备存在数量和类型众多、人工实时监测困难、长期监测难度大等亟需解决等问题,研究和设计智能实时监控和预警解决方案,完成针对铁路智能检测和实时预警,保障铁路的安全稳定运行势在必行。铁路故障检测要求识别上百种故障类型(比如脚蹬破损、端墙板破损等),这些故障发生的概率也大不相同,因为发生概率低,难以获得故障样本,甚至有些故障还没有发生过,标注困难、样本不均衡,以及未知故障的预测成为主要挑战。华为云确定基于盘古视觉大模型,利用大量铁路无标注样本预训练,使其在小样本的故障获取更优的性能;同时基于缺陷检测算法,打造未知故障预测流水线,为铁路故障检测设下第二道关卡。通过盘古预训练模型做智能故障识别,故障召回率达到90%的情况下,准确率提升了7%以上;正常的样本滤除率降低了8.9%。

盘古CV大模型在内部的工厂场景也有一些应用,主要是对手机元器件、零部件关键元器件的检测识别,要满足超高的召回和精度的要求,同时也要满足模型在耗时和大小方面的要求。盘古CV大模型自动化地抽取任意耗时的需求模型,同时自动化生成算法来得到解决方案,总体是一个低成本、高效和可靠的方案。与之前的标准模型相比,同样是40个标注样本,Recall都是在99%以上,准确率从85%提升到了99.5%,精度提升了14.5%,优势非常明显。

盘古CV大模型在工业缺陷检测方面也有应用,比如钢板和电池板原来存在漏检、误检和定位不准确的问题。面对缺陷情况复杂、标注成本高、效率低、不同批次数据存在差异,以及准确率下降严重等问题,盘古大模型的解决方案就是预训练模型 + 数据挖掘。与之前的标准模型相比,在同样达到90%召回率的情况下,第一批次中准确率提升了6%;第二批次的质检中,准确率提升了14%。

(三)多模态大模型

盘古多模态大模型是让AI懂得更多的模态。与过去的单模态相比,多模态是未来必然的发展方向之一。盘古多模态大模型希望让多模态信息的交互成为可能,让AI具备更多的理解能力和创造力。

盘古多模态大模型能够处理跨模态检索、跨模态生成、视觉问答、视觉推理等下游任务。其中跨膜态检索包括以文搜图、以图搜文等。这些任务验证盘古多模态大模型的理解能力;同时跨模态生成包括以文生图、以图生文,这验证着盘古大模型的创造能力;其次、视觉问答、视觉推理是更为高阶的任务,能够让AI具备初级思考能力。

因此,从这些任务我们可以看出,多模态是迈向通用智能的重要途经之一。在时尚领域,我们可以用多模态判别模型来进行以文搜图,也可以用多模态生成模型设计更多服装。在其他场景,我们可以利用多模态生成模型的“无中生有”,来创造更多人物形象。

(四)科学计算大模型

盘古科学计算大模型就是AI与科学计算的融合,希望为传统的科学计算带来新思路、新方法和新工具。传统的科学计算非常严密,具有很好的可解释性,希望能够提升人工智能技术的可解释性,它们之间的结合可以在模型、算法、软件和硬件四个层面体现。

在模型层面,比如通过AI建模实现分子力学中的大规模分子模拟。在算法方面,比如物理学中,AI求解用神经网络求解薛定谔方程;生物学中,通过AI算法,实现蛋白质结构预测这样的工作。在软件层面,AI框架加速优化。在硬件层面,AI芯片适配,人工智能对芯片、处理器、系统等都有深刻的影响。

下面介绍盘古科学计算大模型的一个最新工作——全球海浪浪高的实时预测,包括三个部分。第一,多模态的数据建模,多模态数据包括地形数据、气象数据和台风轨迹,从海量的多模态数据中提取海量的知识和规律;第二,把传统的科学计算问题,就是偏微分方程求解问题,等价编程进入AI模型;第三,虚实数据融合,把仿真、实时的观测数据与行业知识相结合。最后我们得到了盘古海洋大模型,实现了高精度、可解释、多模态和实时预测,实现了全球覆盖和高精度预测。可预测地区覆盖了全球90%以上的海域,海浪浪高绝对误差小于10厘米,精度和覆盖范围与传统科学计算的方法相当;但AI的求解相对于传统方法,加速超过了1万倍。传统方法,比如用超算中心,像太湖之光预测一次可能需要3~6个小时,预报结果滞后;AI模型仅需1秒,可以进行实时预测。

在科学计算方面,今年9月华为云盘古家族再添新“丁”,发布了“盘古药物分子大模型”,旨在帮助医药公司开启AI辅助药物研发的新模式。此模型研究了17亿个小分子的化学结构,实现了对小分子化合物的深度表征。从而可以高效生成药物新分子,计算蛋白质靶点匹配,预测新分子生化属性,并对筛选后的先导药进行定向优化,实现全流程的AI辅助药物设计。

我们也在基因组测序做了AI加速。第三代基因组测序中,有一个步骤叫做电信号转换成碱基序列,这是一个AI算力消耗最大,影响测试精度最重要的步骤。目前精度最高的是美国的Bonito系统,但Bonito系统速度较慢,无法满足实际应用的需求。我们对Bonito做了一个全栈的协同加速,主要包括软件优化、模型优化和硬件优化。比如,模型优化做了数据增强、模型蒸馏,也做了搜索硬件亲和、高精度的神经网络结构等。从结果看出,FastBonito比过的速度提升了5倍以上 , 过去10万个样本耗时1 000万GPU小时,经过全栈协同加速,分析时间减少到200万NPU小时。

二、AI 学术和人才生态方面的进展

华为的智算中心希望为科学研究提供充沛的算力,支持试验区战略目标达成。这里的科学研究包括AI+多模态、AI+遥感、AI+医疗、AI+气象等,智算中心包括成都、西安、武汉超算中心和鹏城实验室。华为云希望培养 30万开发者,目前完成的情况是,华为云开发者社区的数量、流量均排 BG第一,引入了外部专家40多人,举办了开发者活动200多场,并且 ModelArts在80多个高校开课。2020年华为云还发起了经典的论文复现活动,覆盖25所高校(C9院校全覆盖),累计发布51篇论文,已经在华为云的AI应用市场上线;同年举办了13场AI大赛,有6万多人参赛,提交作品超过9万个。

人才生态方面来讲,智算中心助力高校教学合作和模型众筹的开发合作,发布了新一代人工智能系列教材,让昇腾成为高校理工科学生必备技能;同时围绕人工智能云基地、超算中心等,组织开发者技术沙龙,让商业用户看到云上软件平台和用户生态价值的各种技术沙龙,增加云和客户的技术黏度。华为云的AI训练营提供了云AI基础课,提供了盘古大模型的一些培训视频,包括自然语言处理,还有知识图谱、各种线下的沙龙,以及举办AI的实战营。在生态补齐方面,通过论文激励+模型众筹开发计划,激励开发者进行基础软件的创新。此外,我们内部的EI特战队和外部的高校老师、外部的专家定期举办活动,分享最新研究成果,包括网络架构搜索、视觉语义理解、GAN 等;还有项目需求分析会,挖掘业务的难题。

三、人工智能计算中心赋能全场景

算力是引擎,为智能升级提供澎湃的动力。成都人工智能计算中心如何赋能全场景智慧。

四川省的“十四五”规划和2035远景目标包括建设具有全国影响力的科技创新中心,加快建设国家新一代人工智能创新发展试验区和国家人工智能创新应用先导区,因此成都的人工智能计算中心是依托智算中心打造一个中心三个平台。一个中心就是一体化的大数据中心,目前一期300P的AI算力已经启动建设,大概到2021年底完成;总体规划1000P的算力,计划在2023年完成。三个平台包括城市智脑平台、人工智能算力平台和科研创新平台,希望成都的智算中心助力四川打造人工智能的产业高地。

四、结束语

大模型是当前中美在人工智能技术竞争方面的一个热点,希望通过大模型构筑中国特色的AI技术竞争壁垒。中国华为今年4月发布了盘古大模型,北京智源发布了悟道2.0,百度、阿里也发布了各自的大模型,9月中中科院自动化所研发了紫东太初大模型。我们认为,大模型是AI产业发展底座的重要一环,大模型收编高度定制化的小模型,让市场向大企业集中。大模型可以重新定义AI的产业模式、制定AI的产业标准、主导AI的产业规则、做大AI产业空间,甚至是构筑AI的伦理标准。而且在竞争方面,中国是有一定优势的,因为中国拥有庞大的数据量,在训练大模型方面可以取得很好的成效和构筑竞争的壁垒。当然,大模型也面临着许多风险,比如安全方面的、可解释性方面的一些问题,包括在公平、安全、法律等方面都有一定风险,因此在研究过程中也要慎重考虑。

(本报告根据速记整理)

CAAI原创 丨 作者田奇院士

未经授权严禁转载及翻译

如需转载合作请向学会或本人申请

转发请注明转自中国人工智能学会