- 首页

- ·

- 热门文献

-

演讲实录

-

CAAI会士专栏

-

GAITC 2021 演讲速记

-

GAITC 2020 演讲速记

-

GAITC 2019 演讲速记

-

GAITC 2018 演讲速记

-

GAITC 2017 演讲速记

-

GAITC 2016 演讲速记

-

CCAI 2022 演讲速记

-

CCAI 2021 演讲速记

-

CCAI 2020 演讲速记

-

CCAI 2019 演讲速记

-

CCAI 2018 演讲速记

-

CCAI 2017 演讲速记

-

CCAI 2016 演讲速记

-

CIIS 2020 演讲速记

-

CIIS 2019 演讲速记

-

CIIS 2018 演讲速记

-

CIIS 2017 演讲速记

-

CIIS 2016 演讲速记

-

CCIS 2019 演讲速记

-

CAAI人工智能大讲堂 2018

-

吴奖 2018 演讲速记

-

WRC 2017 演讲速记

-

CIEC 2016 演讲速记

-

2016“探寻大师足迹”系列第二站

-

2016“探寻大师足迹”系列第一站

-

CAAI AIDL 第八期(2019)

-

CAAI AIDL 第七期(2019)

-

CAAI AIDL 第二期(2017)

-

CAAI AIDL 第一期(2017)

演讲实录丨CAAI社会计算与社会智能专委会主任孟小峰教授:算法公平与公平计算

发布时间:2022-08-25

2022年8月11-13日,CAAI 第七届全国大数据与社会计算学术会议(BDSC2022)在杭州成功召开。

会上,中国人民大学信息学院教授、CAAI社会计算与社会智能专委主任孟小峰教授进行了题为《算法公平与公平计算》的主旨报告。报告从历史的角度揭示算法公平的发展过程,并提出从社会偏见、数据偏见、模型偏见三个维度认识算法公平,揭示其相互作用关系。提出了在数字社会下公平计算(Fairness Computing)的解决框架和所面临的挑战问题。

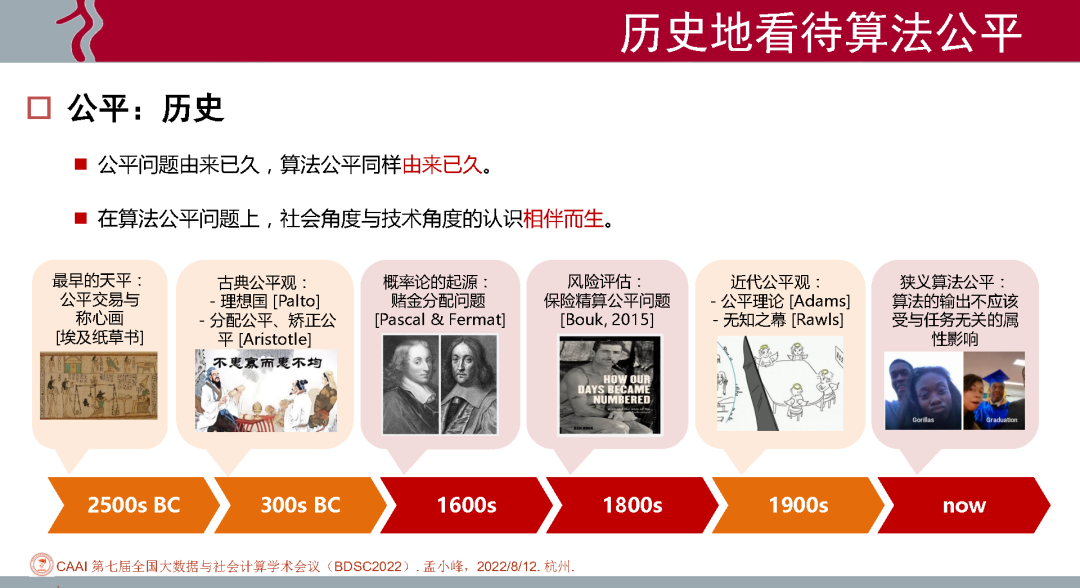

多学科看算法公平

从历史发展的角度来看,公平问题由来已久,算法公平问题同样由来已久。在算法公平问题上,社会角度与技术角度的认识相伴而生。在社会角度,哲学、社会学、心理学对公平都有不同的理解,提出了“无知之幕”、公平理论等公平认知标准,重在理解/判断社会公平现象。在技术角度,数学、经济学、计算机针对不同的问题试图以计算的方式实现公平。数学中的公平问题至少可追溯至概率论的起源,费马与帕斯卡在通信中探讨赌金分配问题;经济学中的公平问题则与保险精算相关;计算机中的公平问题重点关注机器学习算法输出。

对比来看,社会角度重理解,技术角度重求解,而算法公平问题更需要的是能从社会与技术交互作用的基础上加以分析。

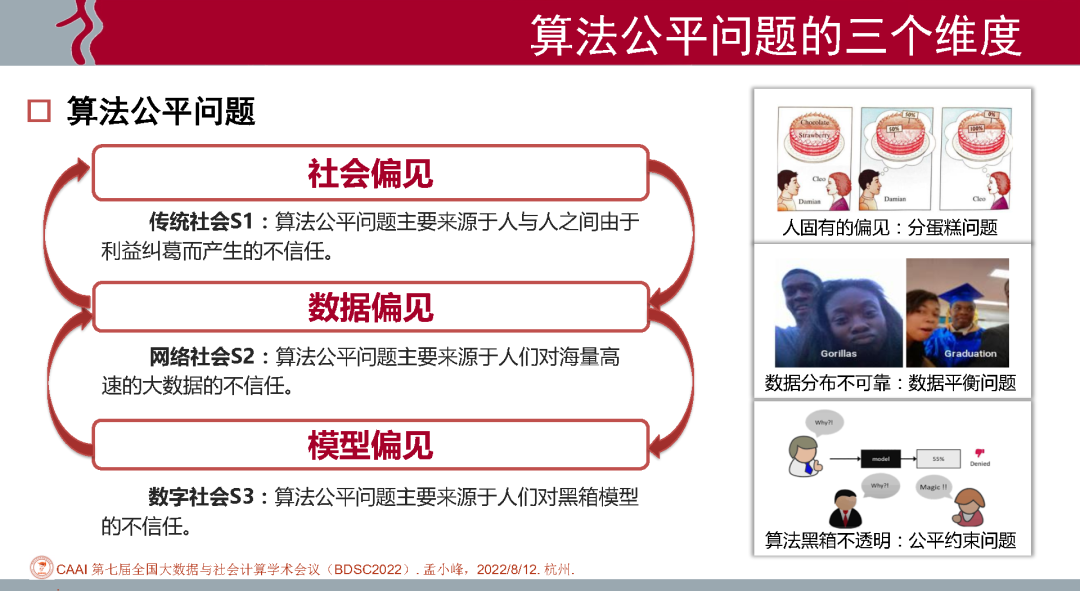

多维度看算法公平

依据算法公平的对象和范围,可对算法公平进行不同的分类。按对象分,算法公平可分为个体公平与群体公平,个体公平是指相似的个体受到相似的对待;群体公平是指不同的群体受到相似的对待。按范围分,算法公平可分为广义算法公平与狭义算法公平,广义算法公平是用算法解决人与人之间的问题;狭义算法公平是人来解决算法与人之间的问题。

我们提出从社会偏见、数据偏见、模型偏见三个维度认识算法公平。社会偏见主要来源于人与人之间由于利益纠葛而产生的不信任,如分蛋糕过程中每个人都有不同的估值。数据偏见主要来源于人们对海量高速的大数据的不信任,带来了数据分布不平衡等问题。模型偏见主要来源于人们对黑箱模型的不信任,带来了公平约束问题。

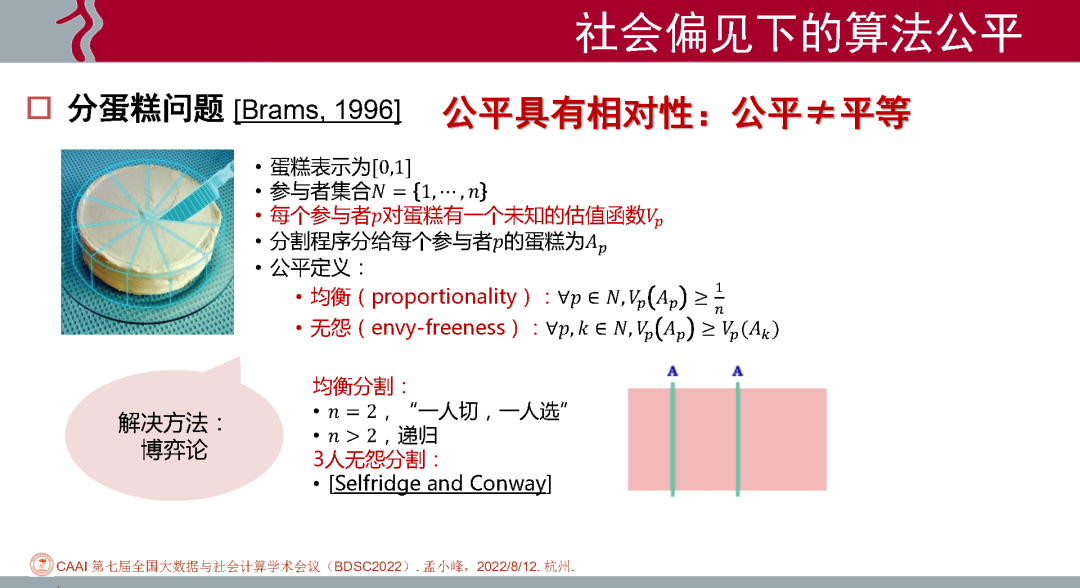

社会偏见下的算法公平

其中,社会偏见下的算法公平分为公平利益分配与公平损失分摊两类。利益分配比如薪酬、教育资源、医疗资源的分配。损失分摊比如房租、保费、环保成本的分摊。利益分配问题通常被建模为分蛋糕的问题。n个人分蛋糕怎样算分的公平?数学家提出了均衡和无怨两种定义:均衡是指每个人都认为自己分得的蛋糕都不少于整个的1/n;无怨是更高的要求,暗含了相互间的比较,是指每个人都认为自己分得的蛋糕都不比别人的少。这类问题通常采用博弈论的方法解决,当只有两个人时,很自然“一人切,一人选”是均衡的分割方案;当人数多于2可以递归进行均衡分割。这个问题很关键性的一点在于“每个参与者都对蛋糕有一个未知的估值函数”,不是分给每个人的蛋糕都完全一样才算公平,这体现出了公平的相对性,公平是可以不等于平等的。

数据偏见下的算法公平

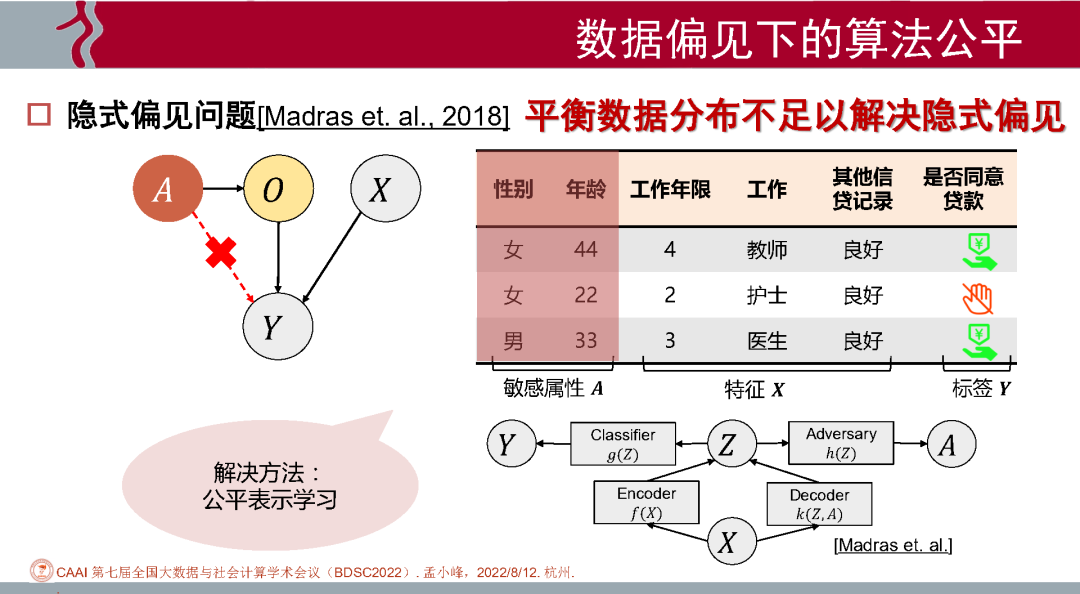

数据偏见下的算法公平分为数据平衡问题与隐式偏见问题两类。数据平衡问题比如黑人识别成大猩猩是由于数据采样不具代表性,标注误差也会带来数据平衡问题。这类问题通常采用数据重采样与重赋权的方法解决。隐式偏见问题比如谷歌新闻训练的词向量中隐含有偏见,男性对应程序员,女性对应家庭主妇。隐式偏见问题无法用平衡数据分布解决的。比如我们虽然消除了“性别”、“年龄”等敏感属性,但是非敏感属性”工作年限”与“年龄”之间存在相关性,导致预测结果仍然会受到敏感属性影响。这类问题通常采用公平表示学习方法解决。

模型偏见下的算法公平

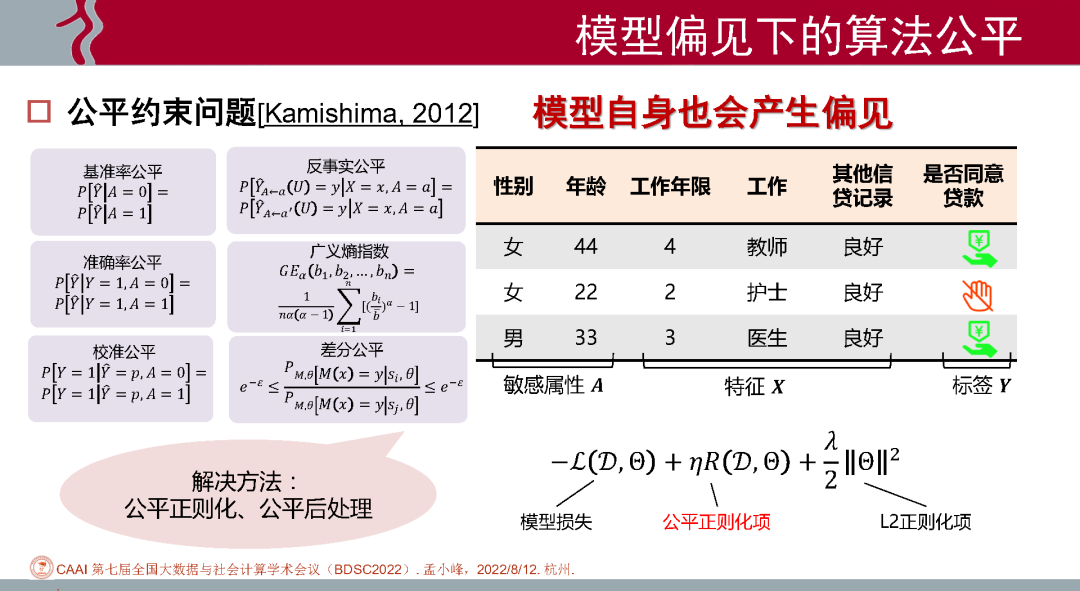

由于模型自身也会因为归纳偏置等原因产生偏见,因此只去除数据偏见也不足够。对于这类模型偏见下的算法公平问题,研究者不再考虑如何处理模型输入,而是考虑如何约束模型输出。研究者从统计(基准率公平、准确率公平、校准公平)、因果推断(反事实公平)、经济学(广义熵指数)、隐私(差分公平)等方向加以借鉴,设计了种种约束指标,把公平约束作为正则化项加入目标函数中,或者以后处理的方式调整模型输出。

算法公平的相互作用

算法公平的这三个维度之间存在着相互作用关系。以AI招聘为例,比如招聘某些岗位,面试官倾向于招聘男性候选人,就会导致社会偏见传递到数据偏见,使得男性简历通过的比例比女性简历通过的比例高;使用含有偏见的数据训练模型,会导致数据偏见传递到模型偏见,AI招聘模型也会倾向选择男性候选人,从而又产生了带有偏见的数据,由此更会加深面试官女性候选人难以胜任的刻板印象,造成偏见的恶性循环。在这三个维度之间,任何环节的改善将促进社会公平正向循环。

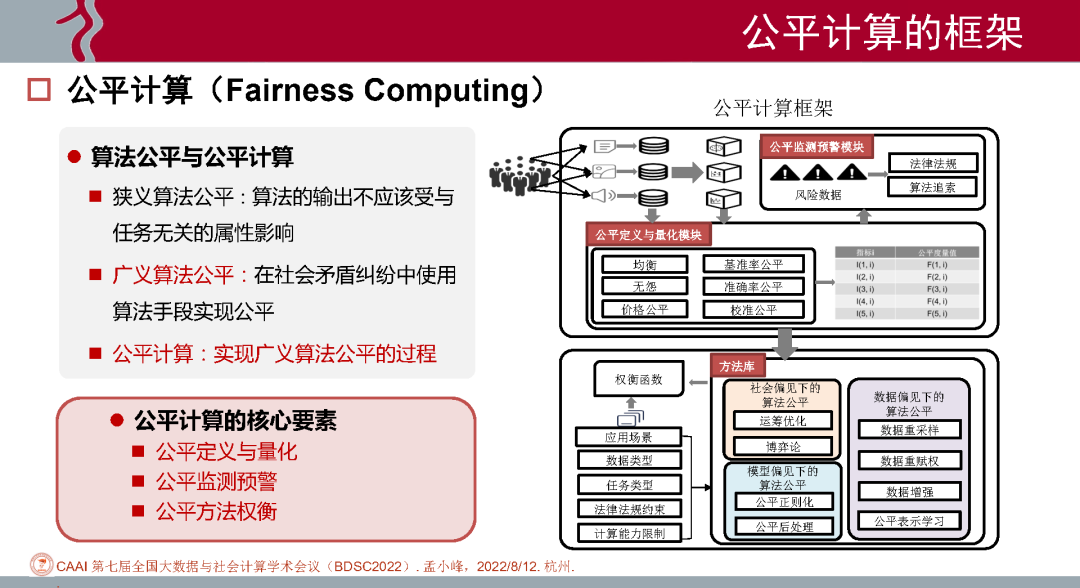

公平计算框架

如前所述,从算法公平的范围上来看,狭义的算法公平是指算法的输出不受与任务无关的属性影响,而从广义上来看,一切使用算法手段在社会矛盾纠纷中实现公平的方法都可算作算法公平范畴。我们将实现广义算法公平的过程称之为“公平计算”(Fairness Computing)。公平计算应该成为AI治理的重要手段,其核心要素包含公平定义与量化、公平监测预警、公平方法权衡等内容。最近我们将这方面的研究成果总结为论文待发表,请大家关注!

孟小峰教授在BDSC2022做大会主旨报告

本文由CAAI社会计算与社会智能专委会供稿